Gemini桌面客户端终于上线:直接读取屏幕上下文,帮你解读一切!

Gemini桌面客户端终于上线:直接读取屏幕上下文,帮你解读一切!Gemini 终于推出桌面客户端了!除了能做网页端的一切,它的杀手锏是能捕捉屏幕上所有窗口,突破浏览器限制,把一切都装进模型上下文,帮你解读一切。

Gemini 终于推出桌面客户端了!除了能做网页端的一切,它的杀手锏是能捕捉屏幕上所有窗口,突破浏览器限制,把一切都装进模型上下文,帮你解读一切。

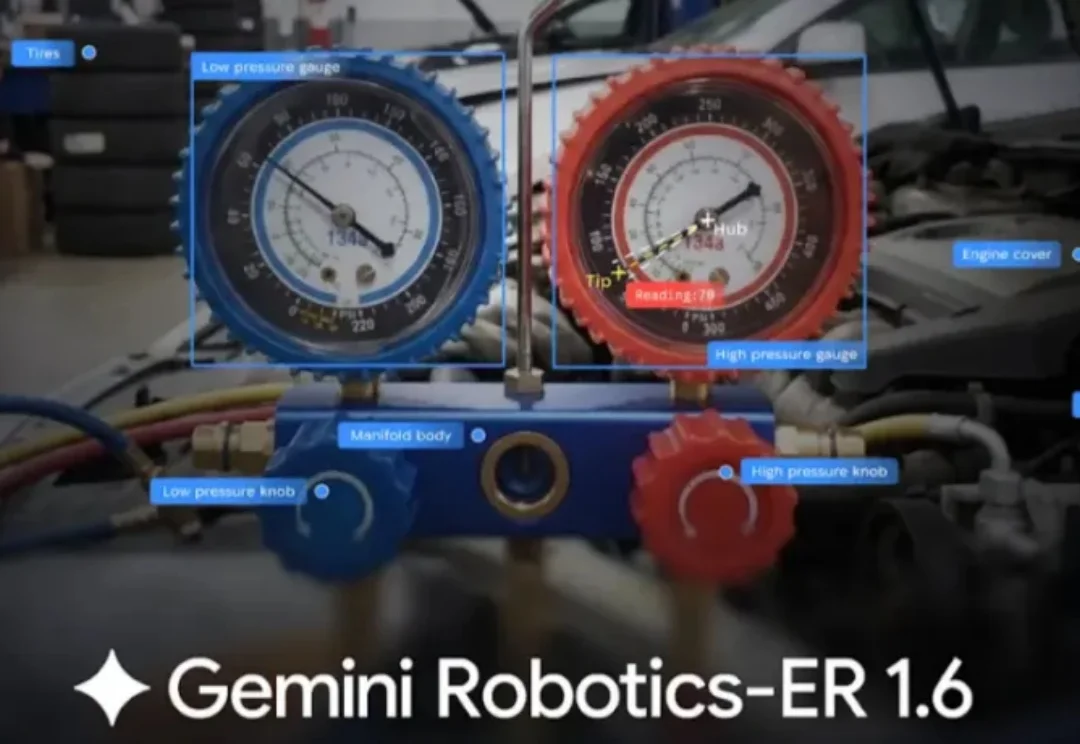

联手波士顿动力,谷歌给机器人装上会读表的脑子。

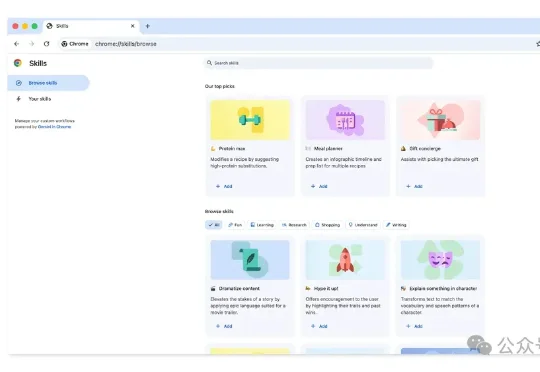

你的浏览器,从今天起进化成免费智能体。谷歌Chrome推出Gemini Skills,一键生成可复用的技能。

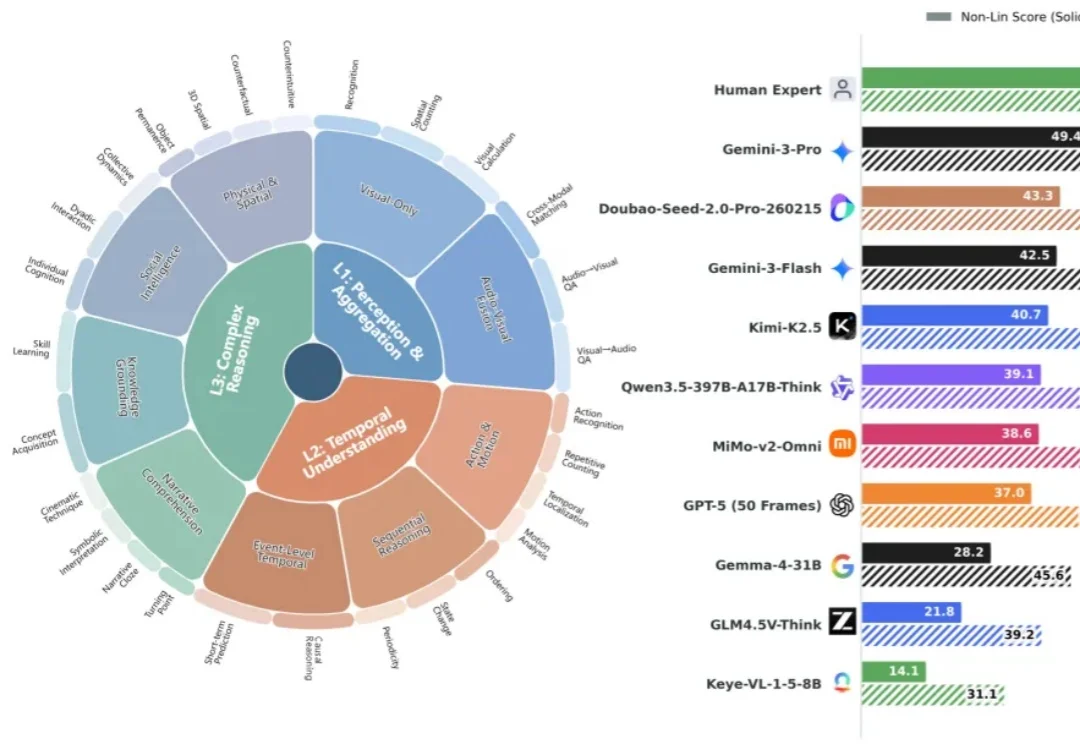

现有大模型评测分数日趋饱和,但与真实体验差距显著。南京大学傅朝友团队牵头,在 Google Gemini 评测团队邀约下推出视频理解新基准 Video-MME-v2。凭借创新的分层能力体系与组级非线性评分,以及 3300 + 人工时高质量标注,揭示模型与人类的巨大鸿沟(49 vs 90)、传统 Acc 指标虚高、以及 “Thinking” 并非总是增益等现象。

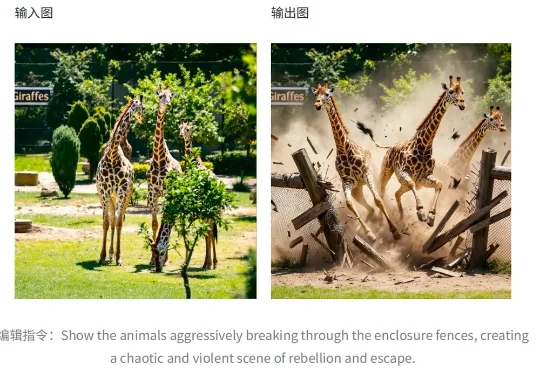

近日,京东开源图像模型JoyAI-Image-Edit,将空间智能纳入图像理解与编辑,让AI开始处理真实世界中的空间关系,让模型真正“理解空间,编辑空间”。简单解释,这是一个以空间智能为核心的图像生成与编辑模型,让 AI 真正“看懂”三维空间,从而让生成更合理、编辑更精准。

谷歌Deep Think横扫亚欧多语种竞赛,AI科研工具的语言壁垒正在被拆掉,数学与科学发现进入AI驱动新时代。

本报告基于XSCT Arena平台,对 Qwen3.6-Plus-Preview(阿里云,2026-04-02 发布)在文字能力(xsct-l)、网页生成(xsct-w)、Agentic 任务(xsct-a)三大场景下的表现进行系统评测,并与Claude Sonnet 4.6、GPT-5.4、Gemini 3.1 Pro、Kimi K2.5、

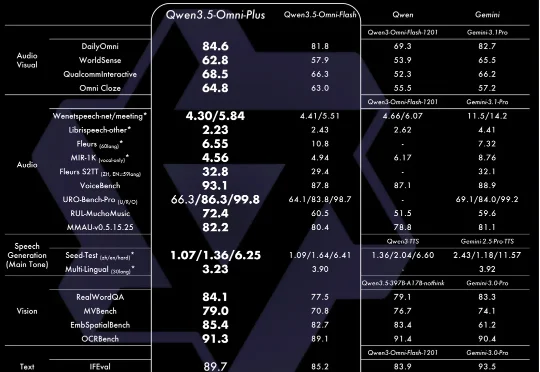

阿里刚刚发布了最新一代全模态大模型 Qwen3.5-Omni,在通用音频理解、推理、翻译和对话等维度,已全面超越 Gemini 3.1 Pro。所谓全模态,在于它拥有了接近人类的“感官”。它能听、能看、能说、能写。

昨日凌晨,谷歌正式推出其最高质量的音频和语音模型——实时语音模型Gemini 3.1 Flash Live,并在Gemini App、Search Live以及Google AI Studio中同步开放,其中后者以预览版本向开发者提供。

谷歌宣布旗下AI设计工具Stitch支持Vibe Design。你都不需要键盘,只需要用嘴就可以vide design出这样婶儿的UI和前端界面:不得不说,谷歌的审美是真的好。Gemini 3生成前端的艺术效果就有口皆碑。